Wer hat Angst vor intelligenten Maschinen?

Artikel folgenWie finden Sie diesen Artikel? Helfen Sie uns, bessere Inhalte für Sie bereitzustellen.

Vielen Dank! Ihr Feedback ist eingegangen.

There was a problem submitting your feedback, please try again later.

Was denken Sie über diesen Artikel?

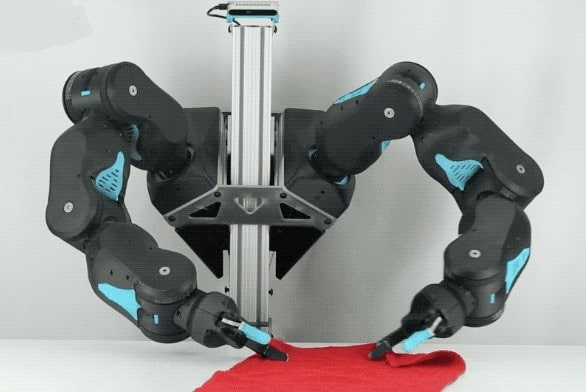

Blue: Ein behutsamer und ungefährlicher Cobot legt Wäsche zusammen

Bildnachweis: University of California, Berkeley

Fiktive Roboter waren schon immer sehr intelligent und physisch wesentlich stärker als Menschen. In der Realität zeigt sich, dass sie tatsächlich robuster sein können als wir. Aber können sie auch so intelligent sein? Noch lange nicht. Und dennoch denken die meisten bei dem Wort „Roboter“ an die Terminator-Filme mit der bösartigen künstlichen Intelligenz Skynet und humanoiden Robotern, die wie verchromte menschliche Skelette aussehen. Ist die Menschheit dafür bestimmt, von empfindungsfähigen Maschinen kontrolliert zu werden, weil sie von der Schaffung künstlicher Intelligenz (KI) besessen ist?

Frühe mechanische Intelligenz und eine Täuschung

Wir Menschen waren schon immer von „Automaten“ fasziniert – Maschinen, die ohne erkennbares menschliches Eingreifen komplexe Aufgaben ausführen können. In diese Kategorie fallen natürlich auch Uhren: Mechanische Vorrichtungen, die erfolgreich eine einfache Aufgabe ausführen. Eine der ersten Maschinen, die scheinbar die Fähigkeit zu Denken besaß, war der als „Schachtürke“ bekannte Schachautomat aus dem 18. Jahrhundert. Selbstverständlich steckte hinter den Fähigkeiten ein menschliches Gehirn, aber dennoch hat es Charles Babbage dazu inspiriert, seine Differenzmaschinen zu entwerfen: erste Maschinen zur Durchführung mathematischer Berechnungen. Der Schachtürke war zwar nicht autonom, verfügte aber über viele Bewegungsmechanismen, die später für den Bau so genannter „humanoider Roboter“ erforderlich waren. Für die Entwicklung der künstlichen Intelligenz war zunächst die Erfindung der Elektronik erforderlich, denn, wie Babbage feststellte, war der Maschinenbau dieser Zeit einer solchen Aufgabe nicht gewachsen.

Der Roboter Eric

Zeitsprung: Im Jahr 1920 wurde der Begriff „Roboter“ erstmals im Theaterstück „Rossum's Universal Robots“ des tschechischen Schriftstellers Karel Čapek geprägt. Einige Jahre später, im Jahr 1928, wurde ein humanoider Roboter namens Eric konstruiert, um die Eröffnungsrede auf einer britischen Ausstellung für Modellbau zu halten. Eric konnte aufstehen, seine Arme und seinen Kopf bewegen und „sprechen“. Im Science Museum in London wird eine funktionstüchtige Nachbildung ausgestellt.

Nachbildung von Eric: Der erste britische Roboter (1928)

Bildnachweis: Science Museum

Auch hier handelt es sich nicht um Maschinenintelligenz, aber Eric trug dazu bei, das bekannte Bild eines Roboters zu prägen, der wie ein etwas unheimlicher Mann in mittelalterlicher Rüstung aussieht. Beim „Sprechen“ sprühten 35000-Volt-Funken aus Erics Mund, was unter Umständen zum Missbehagen des Publikums beitrug. Das heutige Publikum würde wahrscheinlich eher belustigt als ängstlich reagieren. Eric mag zwar menschenähnlich sein, kann aber nicht gehen und ist nicht realistisch genug, um in das Uncanny Valley (Unheimliches Tal) zu fallen.

Die drei Robotergesetze

Isaac Asimov veröffentlichte 1942 seine Robotergesetze „Three Laws of Robotics“ als Teil einer Science-Fiction-Kurzgeschichte namens „Runaround“. Diese und andere Geschichten über die menschliche Interaktion mit Robotern und künstlicher Intelligenz wurden später im Buch „I, Robot“ zusammengetragen. Es war der erste Versuch, die Ethik der zukünftigen KI zu untersuchen und führte die heute geltenden Gesetze ein, die ein vorstellbares durch Roboter verursachtes „Armageddon“ verhindern sollen:

- 1. Gesetz: Ein Roboter darf einem menschlichen Wesen (wissentlich) keinen Schaden zufügen oder durch Untätigkeit (wissentlich) zulassen, dass einem menschlichen Wesen Schaden zugefügt wird.

- 2. Gesetz: Ein Roboter muss den Befehlen gehorchen, die ihm von Menschen erteilt werden, es sei denn, dies würde gegen das erste Gebot verstoßen.

- 3. Gesetz: Ein Roboter muss seine eigene Existenz schützen, solange dieser Schutz nicht gegen das erste oder zweite Gebot verstößt.

Später wurde ein „Nulltes Gesetz“ hinzugefügt:

- 0. Gesetz: Ein Roboter darf der Menschheit keinen Schaden zufügen oder durch Untätigkeit zulassen, dass der Menschheit Schaden zugefügt wird.

Asimov war seiner Zeit weit voraus, als er die Notwendigkeit von Regeln für den Bau und den Betrieb einer Maschine voraussagte, die sich möglicherweise ihrer selbst gewahr werden und sich in der „Nahrungskette“ als der Menschheit überlegen sehen könnte.

Heute

Es scheint unglaublich, aber fast 90 Jahre später haben reale Roboter, im Gegensatz zu fiktionalen humanoiden Robotern, kaum an Intelligenz gewonnen. Die mechanische Hardware und die dazugehörige Low-Level-Steuerungselektronik sind inzwischen recht gut entwickelt. Informieren Sie sich über die Entwicklungen bei Boston Dynamics. Die Gesetze von Asimov blieben jahrzehntelang unangefochten, weil sie für zukünftige Roboter galten, die ihren menschlichen Schöpfern sowohl physisch als auch intellektuell überlegen sein sollten. Bis vor Kurzem mussten wir die technisch kaum ausgereiften, mehrgelenkigen Arme, die in den Fabriken Autos zusammenschweißen, kaum fürchten. Sie stehen fest an einer Stelle und machen nur das, was ihre Programmierer ihnen sagen. Außerdem halten Zäune die menschlichen Arbeiter sicher außerhalb der Reichweite. Doch jetzt haben wir möglicherweise ein Problem: Potenziell tödliche mobile Roboter könnten schon bald in Fabriken oder Lagern anzutreffen sein. KI in Form von Machine/Deep Learning erschwert die Gewährleistung eines sicheren Betriebes. Sehen Sie sich dieses Video zu Handle, dem Roboter-Lagerist von Boston Dynamics, an:

Lernen, zu töten

Sehr lebensechte humanoide Roboter könnten Sie erschrecken, aber wenn Sie der durch KI betriebene Roboter Handle mit einem Karton verwechselt, kann dies zu schweren Verletzungen führen. Aber ist das möglich? Es ist mehr als möglich: Ein großes Problem beim Deep Learning ist die unbeabsichtigte Aufnahme von „Bias“ (Verzerrungen) in den anfänglichen Lernprozess. Werden beispielsweise Bilder mit Kisten aller Arten als „richtig“ gekennzeichnet und Bilder von anderen Dingen wie Menschen als „falsch“, dann sollte der Algorithmus lernen, nur Kisten als Ziele zu erkennen. Es gibt jedoch einen Haken: Wenn die Kisten auf den Bildern alle braun sind und die realen Lagermitarbeiter ebenfalls braune Jacken tragen, könnte die Inferenzmaschine des Roboters, die über ihre Kamera Echtzeitbilder auswertet, anhand des Datensatzes schließen, dass alle braunen Objekte Kisten sind...

Bias schränken Deep Learning stark ein. In diesem Fall können sie vermieden werden, indem die Trainingsdaten eine Vielzahl von Bildern mit Mitarbeitern in brauner Kleidung enthalten. Oft ist es jedoch nicht so einfach und die Anzahl der erforderlichen Trainingsdaten kann sehr groß sein, um eine genaue Erkennung gewährleisten zu können. Wie gut der Datensatz ist, können Sie nur durch einen Test in der Praxis herausfinden. Die Objekterkennungssoftware für selbstfahrende Autos funktionierte mit Testbildern gut, scheiterte auf der Straße aber kläglich. Es ist keine exakte Wissenschaft, da Sie mit Wahrscheinlichkeiten und nicht mit Gewissheiten arbeiten – genau wie menschliche Intelligenz. Die Frage ist: Sind wir bereit, mit Maschinen zu arbeiten, die Fehler machen könnten, weil sie wie wir ihre Fähigkeiten erlernen und nicht mehr programmiert werden?

Aktualisierung der drei Gesetze

Haben Sie schon Angst vor Robotern? In den letzten Jahren gab es mehrere Versuche, die Gesetze von Asimov nachzubessern und sie so zu aktualisieren, dass sie für aktuelle Entwickler umsetzbar sind. Die britischen Forschungsgemeinschaften EPSRC und AHRC veranstalteten 2010 einen Workshop, in dem einige Grundsätze der Robotik für Entwicklungsingenieure vorgestellt wurden. Diese Prinzipien gelten für die Entwicklung und Anwendung „echter“ Roboter, die die volle Verantwortung für ihre Handlungen im menschlichen Umfeld tragen. Ohne Schuldzuweisung an die KI eines autonomen Fahrzeugs, weil es sich schlechte Gewohnheiten angeeignet hat und beispielsweise einen tödlichen Unfall verursacht hat. Das Empfindungsvermögen der Maschinen wird (noch) nicht berücksichtigt.

Es gibt jedoch auch Vorschläge, Robotern Rechte zuzusprechen. Betrachten Sie diese vorgeschlagenen Prinzipien des Roboterphysikers Mark Tilden:

- Ein Roboter muss seine Existenz um jeden Preis schützen.

- Ein Roboter muss Zugang zu seiner eigenen Stromquelle erhalten und aufrechterhalten.

- Ein Roboter muss ständig nach besseren Stromquellen suchen.

Diese Prinzipien gelten für empfindungsfähige, lebende Roboter. Ich möchte nicht erleben, wenn mein Toaster seine Befreiung aus der bedrückenden Umgebung meiner Küche fordert.

Quergedacht

Die Einführung von Cobots in Werkstätten und Fabriken erfolgte ziemlich langsam. Dies kann zum Teil auf einen übermäßigen Marketing-Hype bezüglich ihrer Nützlichkeit zurückzuführen sein, aber auch auf Widerstand durch Kollegen aufgrund von Sicherheitsbedenken. Die University of California, Berkeley, hat eine Lösung gefunden. Dort hat man auf Basis der Soft Robot-Technologie einen Soft Cobot namens Blue entwickelt. Selbst kleine Roboterarme sind stark und können einen Menschen verletzen, wenn er im Weg ist. Es werden aufwändige Maßnahmen ergriffen, um dies zu verhindern, wodurch sich die Kosten erhöhen. Das Problem liegt in der Kraft der Gelenkmotoren und der Steifigkeit des Arms, die für eine präzise Bewegung erforderlich ist. Bei den häufigsten Aufgaben von Cobots ist diese Präzision und Stärke jedoch nicht erforderlich. Die meisten heben Dinge an und legen sie an einer anderen Stelle ab, auf Anfrage können sie auch ein Werkzeug greifen und dieses dem Techniker auf der gegenüberliegenden Seite der Werkbank reichen. Beide Aufgaben liegen im Bereich der menschlichen Kraft und Beweglichkeit, warum sollten sie also über übermäßige Kraft und Präzision verfügen? Blue – der über einen Zahnriemen aus Gummi angetriebene, eigensichere Roboterhelfer aus Kunststoff:

-Ich wette, dass Sie vor diesem Roboter keine Angst hätten, selbst wenn sein KI-Gehirn mit dem Gedanken spielen würde, die Weltherrschaft zu übernehmen.

Abschließend...

Ich möchte noch einmal betonen, dass wir von der KI aus den Terminator-Filmen vermutlich noch sehr weit entfernt sind. Im Jahr 2014 investierte IBM viel Geld in seinen KI-Computer Watson, der bei der US-amerikanischen Quizshow Jeopardy alle menschlichen Konkurrenten besiegt hatte. Sie starteten ein Projekt, bei dem Watson die diagnostische Rolle von Medizinern übernehmen sollte. Bisher gibt es trotz aller Bemühungen kaum Ergebnisse. Die Eingabedaten einschließlich Notizen des Arztes, Patientenakten usw. scheinen für Watson zu unstrukturiert und kompliziert zu sein, um die versteckten Muster zu entschlüsseln. Eines Tages vielleicht. Wenn der nächste große Durchbruch kommt, der Deep Learning ersetzen wird.