Les réseaux de neurones boostent l'intelligence artificielle.

Suivez l'articleQue pensez-vous de cet article ? Aidez-nous à vous fournir un meilleur contenu.

Merci! Vos commentaires ont été reçus.

There was a problem submitting your feedback, please try again later.

Que pensez-vous de cet article ?

L’intelligence artificielle ou IA est présente dans l’esprit des chercheurs et rêveurs depuis les années 60.

La communauté scientifique progresse chaque jour

Les mesures physiques permettant de simuler nos 5 sens, ouïe, odorat, goût, toucher, vue sont aujourd’hui maîtrisées. Il s’agit d’une première étape essentielle pour que chaque machine puisse interagir avec son environnement.

Bien évidemment, nos organes sensoriels oreilles, nez, langue, doigts et yeux ne sont rien sans un organe pour traiter toutes ces informations, notre cerveau.

Vous allez me dire « il existe » … Oui en effet ! Il s’agit des processeurs ou des microcontrôleurs. Ces unités de traitement sont capables d’agir et réagir grâce à leur programmation. Ces pseudo-cerveaux artificiels traitent les données selon une logique orchestrée par un programme. Aujourd’hui ce niveau d’intelligence artificielle nous permet de réaliser des machines pouvant nous remplacer déjà dans de nombreuses tâches monotones, à productivité élevée que l’homme ne peut atteindre ou encore dangereuses.

Mais voilà, nos écrivains et scénaristes nous ont promis bien plus. Des êtres humanoïdes pouvant réfléchir, apprendre et créer, mais aussi faire preuve de sentiments (ou pas comme certaines machines malfaisantes de romans ou films)

Une des pistes en plein essor ces cinq dernières années, pour concevoir cette intelligence, est le ‘deep learning’.

Ce procédé est un sous-ensemble du ‘machine learning’. (qui elle-même fait partie de l’Intelligence Artificielle)

Le machine learning est une technique de traitement des données basée sur des algorithmes de statistiques et de probabilités qui permet à des machines ou programmes d’obtenir une forme de prédiction après une phase d’apprentissage.

Cette méthode est utilisée par exemple pour les analyses comportementales des internautes, la détection des fraudes à la carte bancaire sur le WEB, ou pour prédire l’évolution d’un marché financier.

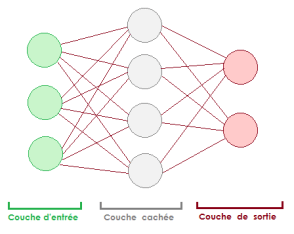

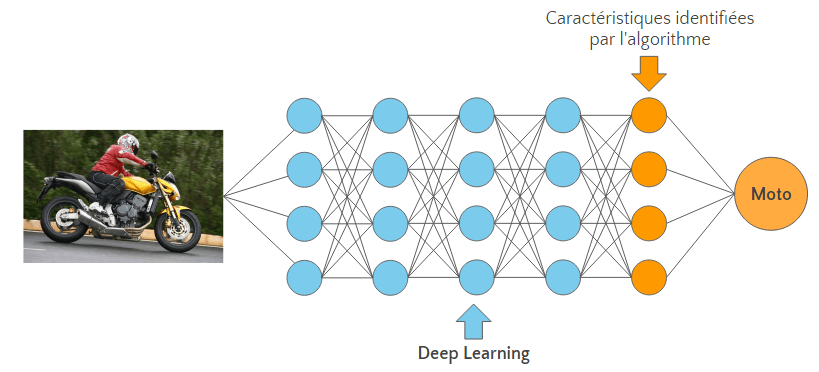

Cependant ce procédé a ses limites en termes d’entrée et de traitement des relations entre les entrées/sorties, ce qui pose un problème pour des traitements plus complexes comme notamment dans la reconnaissance visuelle. En effet dans ce cas, ce que l’on appelle aussi la vision machine requiert des centaines de milliers d’entrées et une capacité de traitement démesurée pour déterminer les relations entre les entrées et sorties des algorithmes (exemple une image de 400 x 400 pixels demande 160 000 entrées). Pour pallier au problème, on fait appel un type d’algorithme basé sur une construction mathématique inspirée de la structure et le fonctionnement des réseaux de neurones humains, CNN (Convolutional Neural Networks).

Jusqu’à récemment, la structure des réseaux de neurone était limitée, dans la pratique à 3 couches (1 couche d’entrée, 1 couche sortie et une couche intermédiaire). Et devait de ce fait être associée à des algorithmes intermédiaires permettant d’extraire des caractéristiques afin de limiter le nombre

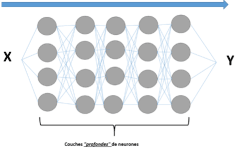

Mais les récents progrès réalisés dans le traitement des données hardware permettent de construire des réseaux pouvant atteindre désormais 100 couches comprenant au total plusieurs millions de neurones artificiels. C’est ce que l’on appelle le ‘Deep learning’. Cette évolution de structure offre ainsi la possibilité de supprimer l’algorithme intermédiaire et de présenter une image brute au réseau de neurones.

Cette avancée est due à plusieurs facteurs comme notamment l’évolution des algorithmes basés sur la structure neuronale, la puissance de calcul des cartes graphiques (GPU), mais également à la disponibilité des données. En effet, de tels réseaux de neurones demandent une phase d’apprentissage qui requiert une banque de données contenant des millions d'informations. Une telle banque est dorénavant disponible notamment pour la reconnaissance visuelle sur le site internet image.net qui stocke plus de 15 millions d’images liées à des descriptions et classées selon 22 000 catégories).

Avec une telle technologie les machines peuvent être maintenant dotées d’un ensemble de fonctions liées à la connaissance qui met en jeu la mémoire, le langage, le raisonnement, l'apprentissage, l'intelligence, la résolution de problème, la prise de décision, la perception ou l'attention.

Les humanoïdes provenant de notre imagination collective deviennent réalité !

...

Surpris par une évolution extrêmement rapide de l’intelligence artificielle, Bill GATES, Elon MUSK et Stephen HAWKINGS ont récemment manifesté leur préoccupation sur les risques d’un développement non contrôlé de l'intelligence artificielle. Suite à cette prise de parole, des initiatives se multiplient afin d’établir une réglementation pour mieux contrôler son développement.

Pensez-vous que cette réglementation sera suffissante pour éviter un scénario catastrophe à la ‘Terminator’ ?

Faites part de votre point de vue à communauté ! Laissez un commentaire.